Tiefe neuronale Netze sind ein wesentlicher Bestandteil des autonomen Fahrens, da sie bei einer Reihe von Aufgaben, insbesondere bei der bildbasierten Umgebungswahrnehmung, unübertroffene Leistungen erzielen. Dennoch sind sie anfällig für zufällige oder gezielte Störungen, was die Arbeit mit diesen Modellen in sicherheitskritischen Anwendungen erschwert. Etwaige Störungen können natürliche Ursachen haben, wie Überbelichtung, Nebel, Schnee, oder künstlich und absichtlich erzeugt worden sein. Ein Beispiel hierfür sind gegnerische Angriffe.

Gezielt herbeigeführte Fehler in Vorhersagen sind für menschliche Betrachter meist offensichtlich: Denn Menschen wenden intuitiv mehrere Regeln auf der Grundlage ihres Wissens und ihrer Erfahrung an, um zu erkennen, was in einer bestimmten Szene geschieht. Neuronale Netze in ihrer gegenwärtigen Form zielen darauf ab, diese Regeln implizit aus Daten zu lernen. Das erfordert die Erfassung und Annotation großer Mengen von Eingaben und birgt darüber hinaus die Gefahr, falsche Korrelationen anzunehmen. Die Integration von Szenenwissen in das Training oder die Inferenz neuronaler Netze scheint eine Lösung zu sein. Allerdings reicht dieses Wissen von Überlegungen zur Szenengeometrie über allgemeines Wissen bis hin zu Regeln des menschlichen Verhaltens und wird damit zu einer komplexen Herausforderung. Es gibt dabei nicht nur eine Reihe von konkurrierenden Ansätzen zur Integration von Wissen, sondern auch mehrere Möglichkeiten, dieses Wissen selbst darzustellen.

Probabilistic Soft Logic für die Wissensaufnahme

Wir untersuchen eine Methode zur Darstellung von Wissen in Form von Beziehungen, die als logische Regeln zwischen identifizierten Objekten in einer Verkehrsszene beschrieben werden, und analysieren, wie diese Beziehungen zur Robustheit der datengesteuerten Umgebungswahrnehmung genutzt werden können. Während mehrere bestehende Forschungslinien ausschließlich Domänenwissen für die Erstellung eines Modells verwenden, ist es unser Ziel, den datengesteuerten Ansatz und High-Level-Wissen im Rahmen der Inferenz zu kombinieren.

Um Verkehrsszenen zu verstehen und darüber nachzudenken, orientieren sich die meisten Menschen anhand von Beziehungen zwischen Objekten. Unter der Voraussetzung, dass alle Objekte identifiziert wurden, kann das gemeinsame Wissen – das sowohl das Verhalten als auch die Merkmale beschreibt – in Form von Regeln abgegrenzt werden.

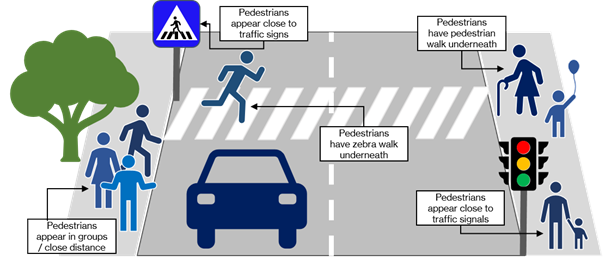

Bei verschiedenen Verkehrsszenen kann der Mensch typischerweise allgemeines und empirisches Wissen über das Verhalten und die Merkmale von Objekten nutzen, um auf ihre Art und Beziehungen innerhalb der Szene zu schließen. Dies gilt auch für ungesehene Szenarien. Dieses allgemeine Wissen, das verschiedene Merkmale und Beziehungen von Objekten berücksichtigt, kann teilweise als eine Reihe einfacher Regeln kodiert werden. Die Art und Weise, wie ein Mensch über seine Umgebung nachdenkt, kann jedoch nicht auf strenger Boolescher Logik basieren, bei der Regeln strikt wahr oder falsch sind. Ein Objekt, unter dem ein Zebrastreifen verläuft und das in der Nähe eines Verkehrsschildes steht, ist mit hoher Wahrscheinlichkeit ein Mensch. Es besteht aber auch die Möglichkeit, dass es sich um ein anderes Objekt handelt, zum Beispiel um einen Hund oder ein Hindernis auf einer Baustelle. Um solch hochrangiges menschliches Wissen auf die gleiche „unsichere“ Weise in ein neuronales Netz zu integrieren, müssen wir logische Regeln mit „lockeren“ Wahrheitswerten definieren. Zu diesem Zweck adaptieren wir das Probabilistic Soft Logic (PSL) Framework, um Beziehungen zwischen Objekten in der Umgebung zu definieren und zu lernen. Wir haben PSL aus zwei Gründen als Rahmen für die Wissensrepräsentation gewählt:

- Erstens erlaubt sie uns die flexible Verwendung von weichen Wahrheitswerten, die sowohl für die Definition strenger als auch lockerer Regeln geeignet sind.

- Zweitens können anhand von Daten Feinabstimmungen vorgenommen werden, das heißt aus den gegebenen Annotationen kann direkt Wissen höchster Qualität gewonnen werden.

Das übergeordnete Ziel des Einsatzes von PSL für die kamerabasierte Wahrnehmung beim autonomen Fahren besteht darin, leicht extrahierbare Teile des allgemeinen Wissens über die Verkehrsszene zu nutzen und sie in einer Form darzustellen, die eine Integration in die Inferenz des neuronalen Netzes ermöglicht.

Schritte zur Beschreibung der Umgebung als Regeln. Ein Beispiel für eine Regel für diesen Frame mit ausgewählten Objekten kann lauten: “Steht_auf_Fußgängerweg ⋀ Steht_nahe_Ampel → Klasse_ist_Fußgänger”.

Zunächst müssen wir jedoch die Objekte identifizieren, über die wir Schlussfolgerungen ziehen wollen, sowie deren Beziehungen, die in ausgewählten Prädikaten kodiert sind. Dann definieren wir einen Satz von Regeln, der zusätzliches relationales Wissen über den Bereich, der von Interesse ist, enthält. Dieses Wissen ist dadurch gekennzeichnet, das es noch nicht durch die annotierten Daten abgedeckt ist und somit zur Unterstützung und Validierung der Wahrnehmungsaufgabe eingesetzt werden kann. Bei der Definition eines initialen Regelsatzes müssen die Objekte, die verbunden werden, sorgfältig ausgewählt werden: Sowohl die Beschreibung ihres Verhaltens als auch ihre Extraktion aus den Rohdaten sollte einfach sein.

Für unsere Studie haben wir Fußgänger*innen, Verkehrsschilder und Verkehrssignale als drei Arten von Objekten ausgewählt, für die wir Klassen ableiten wollen. Wir setzen ein Orakel ein, um die Objektentitäten zu extrahieren und vernachlässigen dabei zusätzliche Herausforderungen, die sich aus einer unzuverlässigen Objektextraktion ergeben. Das Orakel wird durch die zusammenhängenden Komponenten imitiert, die in der Ground-Truth-Segmentierung gefunden wurden, wobei eine zusätzliche Glättung vorgenommen wird, um zerbrochene Objekte aufgrund von Verdeckungen zu vermeiden.

Wir entwickeln einen ersten Satz von Regeln, deren Gewichtung (das heißt wie hoch die Wahrscheinlichkeit ist, dass sie zutreffen) wir später verfeinern. Die logischen Schlussfolgerungen für eine Objektklasse stützen wir dann auf die semantischen Merkmale, auf die Umgebung der Objekte und auf ihre Beziehungen. Die Umgebungen der Objekte werden anhand der Beobachtungen beschrieben, zum Beispiel was sich unter oder hinter dem Objekt befindet. Außerdem integrieren wir Farbe als semantisches Merkmal, da sie für Verkehrsschilder und Verkehrssignale besonders wichtig ist. Die Regeln, die wir mit Hilfe des Farbprädikats definiert haben, sind zum Beispiel inspiriert von den offiziell festgelegten Farbkombinationen gängiger deutscher Verkehrsschilder. Die Beziehungen zwischen den Objekten werden als Abstandswert auf der Grundlage von Tiefenmessungen angegeben.

In der letzten Stufe muss das über probabilistische Regeln gewonnene Wissen aus dem Datensatz mit den Vorhersagen des neuronalen Netzes, in diesem Fall den semantischen Segmentierungsmasken, kombiniert werden. Für unsere konzeptionelle Demonstration verfolgen wir einen vereinfachten Ansatz, bei dem die aus dem Netz gewonnenen Ergebnisse als vorherige Annahmen in den regelbasierten Rahmen integriert werden.

Insgesamt lässt sich der praktische Ansatz wie folgt beschreiben:

- Identifizierung von Objekten, über die Schlussfolgerungen gezogen werden sollen und Extraktion dieser Objekte aus den Sensordaten (Orakel unter Verwendung der semantischen Segmentierung der Grundwahrheit)

- Konstruktion des Regelsatzes unter Verwendung von Expert*innen- und Allgemeinwissen

- Vorbereitung der erforderlichen Informationen von Sensoren der unteren Ebene für die Inferenz der Regeln (Tiefe, Farben)

- Lernen der Gewichtung der Regeln mit Hilfe eines Trainingssatzes von aufgezeichneten Kamerabildern

- Durchführung der Inferenz mit dem neuronalen Netz und den Regeln auf dem Testsatz von Bildern zur Validierung, möglicherweise unter Verwendung vorheriger Netzausgaben

Den beschriebenen Aufbau haben wir anhand der natürlichen Verfälschungen der Bilder bewertet. Die ersten Experimente zeigen die Durchführbarkeit der beschriebenen Pipeline und ihre positiven Auswirkungen auf die Robustheit der Segmentierungsvorhersagen.

Fazit

Durch die Nutzung menschlichen Wissens ziehen wir Informationen aus verschiedenen Bereichen heran: von Sensoreingaben, wie der Farbe eines Objekts, bis hin zu Szeneneigenschaften, wie den Beziehungen und Abständen zwischen Objekten. Dieser Ansatz ermöglicht es uns, zusätzliche Informationen in die datengesteuerten Modellvorhersagen einzubeziehen und die Zuverlässigkeit der Vorhersagen durch Schlussfolgerungen zu verbessern.

Diese Studie zeigt, welche Vorteile gemeinsames Wissen für die Zuverlässigkeit eines maschinellen Lernsystems haben kann. Zu diesem frühen Zeitpunkt haben wir den mühsamen Schritt vernachlässigt, die Entitäten zu ermitteln, über die das PSL-Framework entscheidet. In der Praxis müssen diese Informationen aus verschiedenen, höchstwahrscheinlich nicht völlig zuverlässigen Quellen zusammengetragen werden, die beispielsweise von zusätzlichen Sensoren (zum Beispiel LIDAR) oder alternativen Verarbeitungsmethoden stammen. Ein weiterer wichtiger Schritt ist die Einbeziehung menschlicher Expert*innen bei der Formulierung von Regeln. Die in dieser Arbeit verwendeten Regeln werden mit dem allgemeinen Wissen über die Fahrsituationen und Umgebungen formuliert, aber sowohl spezifischere Regeln als auch solche Regeln, die einen bestimmten Aspekt der Erkennung abstimmen, benötigen mehrere Iterationen während des Konstruktionsprozesses.